ضمیمه دانش امروز روزنامه اطلاعات نوشت: استفاده بدخواهانه از سیستمهای هوش مصنوعی برای اهداف نامطلوب مثل حملات تروریستی یا عملیاتهای مجرمانه و ضد امنیتی میتواند مرگومیر و ویرانی وحشتناک، جراحتهای وخیم و آسیبهای روانی عمیقی به بار بیاورد، در مقیاسی که بزرگی آن قابل تصور نیست.

ازاینرو، برخی از کارشناسهای جنگ معتقدند که باید در سازمان ملل یک گروه جدید شکل بگیرد که وظایفش به طور خاص روی روباتهای قاتل، حمایت کردن از کشورها برای به حداکثر رساندن فایدههای هوش مصنوعی، کاستن خطرات موجود و احتمالی و بالأخره استقرار مکانیسمهای پایش و مدیریت با توافق بینالمللی متمرکز باشد.

برخی از پهپادهای جنگی خودرانی که در حال حاضر در بازار موجود هستند قابلیتهای مهلکی برای کشتار دارند.

یک نمونه از آنها تفنگهای ثابتی هستند که هدف خود را با حسگرهایشان تشخیص میدهند. مثال دیگر، «سیستمهای پیادهنظام ماژولار هیبریدی مسلح قابل ردیابی» (THeMIS) هستند که ساخته شده و در محیطهای نظامی تحت آزمایش قرار گرفتهاند.

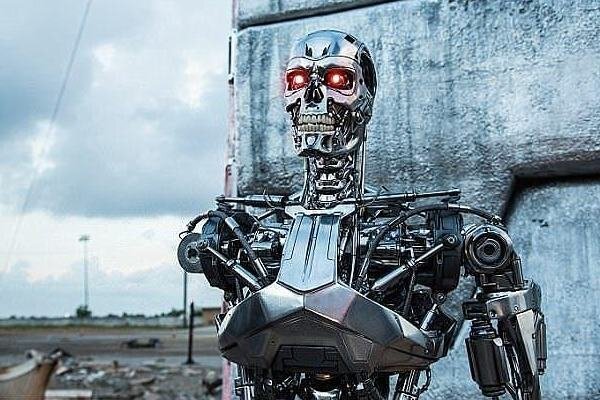

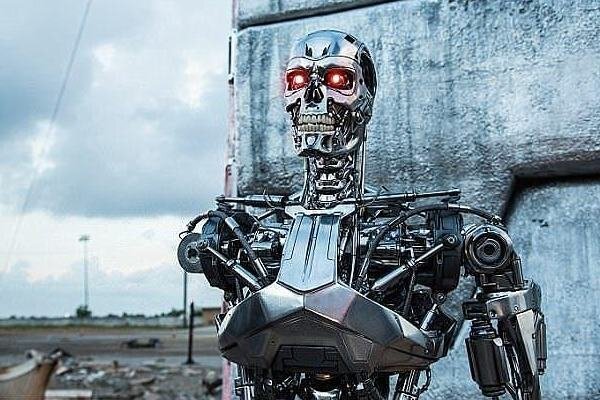

آنها جنگ افزارهای روباتیک شبیه به تانک هستند و برخلاف پهپادها که باید از انسانها دستور بگیرند تا بدانند به کجا بروند و چه کاری را انجام دهند، خودشان میدانند چگونه بدون دخالت انسان ماشه را بکشند یا شلیک کنند. اینها ازجمله روباتهای قاتل هستند که سازمان ملل بارها برای منع استفاده از آنها تشکیل جلسه داده است.

بیشتر کشورهای دنیا از کاربرد روباتهای قاتل در جنگ انتقاد میکنند. از میان 28 کشوری که بین سالهای 2020 و 2021 مورد نظرسنجی قرار گرفتند، 27 کشور مخالف استفاده از این سیستمهای تسلیحاتی خودران بودند.

علت اصلی مخالفت و نگرانی آنها این بود که گسترش جنگ افزارهای خودران مرگبار به معنای عبور از حدومرز اخلاقیات و مجاز بودن در کشتن انسانها است. گروهی از آنها نیز معتقد بودند که روباتهای قاتل نسبت به نقص فنی آسیبپذیر هستند و گروهی دیگر ساخت و استفاده از این روباتها را غیرقانونی میدانستند.